Typen:Konstrukte:Generalisierungen:Eigenschaften:Involvierte Definitionen:- Matrixfaltung

- Aktivierungsfunktion

- ReLU-Aktivierungsfunktion

- Translationsinvarianz

- oft gefolgt von einer Pooling-Operation

Veranstaltung: EMLReferenz: @thimm2024 (Abschnitt 5.2.3, 5.2.4)

⠀

Definition: Conv-Layer

Als Conv-Layer (auch Faltungsschicht) bezeichnen wir eine Schicht in neuronalen Netzwerken, die auf den Eingabedaten eine Matrixfaltung ausführt.

Dabei werden Filter (Kernels) über die Eingabe verschoben, um Merkmale wie Kanten, Texturen und Muster zu extrahieren. Auf jeden Wert der so erzeugten Feature Map wird anschließend noch eine Aktivierungsfunktion (i.d.R. ReLU) angewendet.

Charakteristische für Conv-Layer ist:

- Paramater-Sharing: Dadurch, dass ein Filter auf eine Vielzahl von Einträgen angewendet wird, werden die Gewichte zwischen den Neuronen geteilt.

- Lokalität/Sparse Interaction: In die Berechnung jedes Output-Wertes fließen nur wenige, nah beieinanderliegende Input-Werte ein.

- Translationsinvarianz: Da der Kernel gleichmäßig über das Bild geschoben wird, führt ein “Objekt” (Bildabschnitt/“Patch”) in der oberen linken Ecke zu dem gleichen Ergebnis wie ein identisches Objekt in der unteren rechten Ecke. Die Berechnung ist überall gleich.

Anmerkung

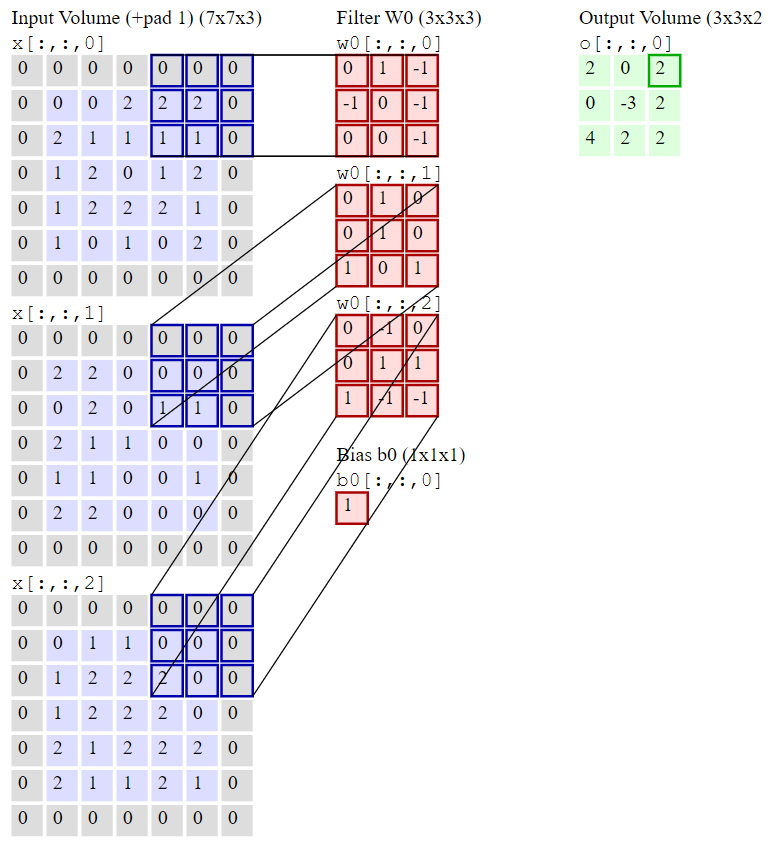

Conv-Layer auf RGB-Bilddaten?

Häufig werden Conv-Layer auf Bilddaten angewendet, die neben einer Höhe und Breite zusätzlich noch verschieden Farb-Channels (i.d.R. RGB) enthalten. Sei

die Anzahl der Channels. Diese Problematik wird in der Praxis meistens so behandelt, dass jeder Filter

nicht nur zwei sondern drei dimensional ist, also . In jedem Schritt (Stride) dieser 3-dimensionalen Matrix-Faltung gehen wir wie folgt vor:

- Wir berechnen die Faltung der

Filter mit der jeweiligen Untermatrix. - Wir summieren die Faltungsergebnisse über die Channels.

- Wir addieren den Bias hinzu.

Machen wir es an dem folgenden Beispiel1 ganz konkret:

In dem aktuellen Schritt gehen wir also wie folgt vor:

Faltungen:

- die sind hier ziemlich einfach, weil die Einträge fast nur Nullen enthalten. Summe über die Faltungen:

Bias hinzuaddieren:

Ergebnis:

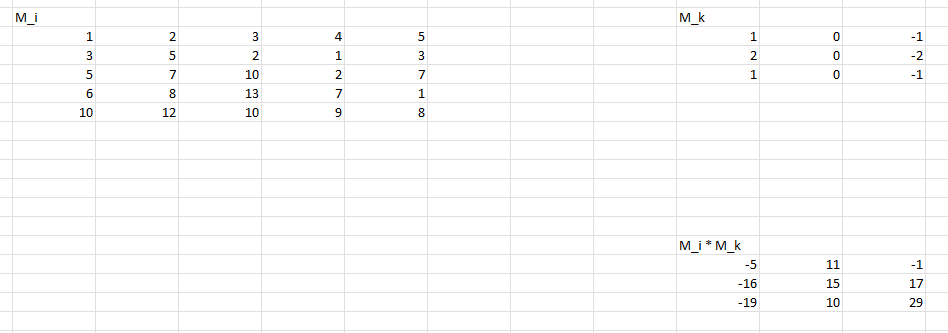

CNN in Excel?

In Excel können wir (einfache) CNN-Layer ziemlich einfach wie folgt berechnen nach dem Schema

=SUMMENPRODUKT(<M_i>; <M_k>)berechnen: