Konstrukte:Involvierte Definitionen:Veranstaltung: EMLReferenz:

⠀

Definition: Feature Pyramid Network

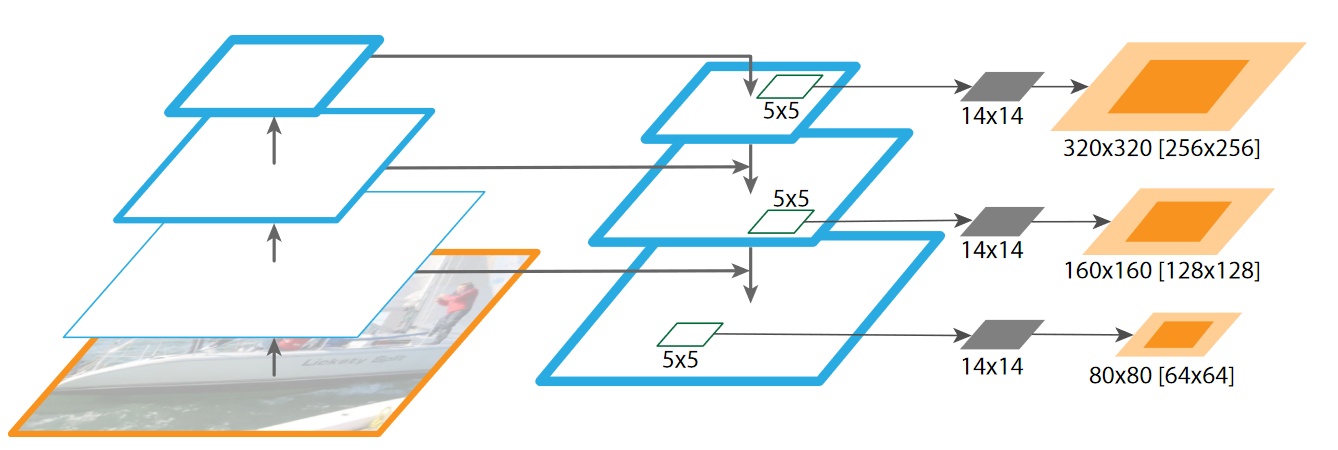

Als Feature Pyramid Network (kurz FPN) bezeichnen wir ein Architekturmuster für neuronale Netzwerke, das Merkmale auf mehreren Auflösungsebenen eines zuvor ausgeführten Grundmodells (i.d.R. das sog. Backbone-CNN) kombiniert, um die Erkennung von Objekten unterschiedlicher Größe zu verbessern.

FPNs bestehen aus einem Bottom-Up-Pfad des Backbone-CNNs zur Merkmalsextraktion und einem Top-Down-Pfad zur Erzeugung angereicherter Feature Maps für die verschiedene Auflösungsebenen.

Der Bottom-Up-Pfad erstellt dabei in jeder Schicht stärker abstrahierte Feature Maps mit jeweils anwachsendem Receptive Field.

Würde man ausschließlich die Feature Maps der letzten Schicht des Bottom-Up-Pfades zur Objekterkennung nutzen, hätte man, so die Intuition, nur noch “globale” Bildinformationen zur Verfügung.

Die Ebenen des Top-Down Pfades haben dabei oft zwei Eingaben:

- Vorige Schicht: Der Top-Down-Pfad erhält als Input immer die Werte der zuvor berechneten Schicht. Damit die Werte Ausgabe der vorigen Schicht genutzt werden kann, wird sie i.d.R. hochskaliert.

- Laterale Verbindung (de. seitliche Verbindungen): Die Ebenen des Top-Down-Pfades korrespondieren zu den Ebenen des Bottom-Up-Pfades. Jede Ebene des Top-Down-Pfades erhält zusätzlich das Ergebnis der korrespondierenden Ebene aus dem Bottom-Up-Pfad als Input.

Die jeweiligen Outputs der Ebenen des Top-Down-Pfades werden anschließend für verschiedene Vorhersagen genutzt, bspw. Bounding-Box Koordinaten und zugehörige Klassen-Labels.

In dem Paper von Lin et al.1 werden bspw. jeweils

-Pixel Ausschnitte der jeweils produzierten Feature Maps für die Vorhersage von Bounding Boxen unterschiedlicher Größe genutzt:

Anmerkung

Laterale Verbindungen und ResNet?

Die lateralen Verbindungen können wir auch als Residual-Verbindungen interpretieren, die die tieferen Ebenen des Bottom-Up- sowie die überliegenden Ebenen des Top-Down-Pfades überspringen.