Typen:Konstrukte:Involvierte Definitionen:Veranstaltung: EMLReferenz:- @murphy2022 (P. 449 f. und 481 f.)

- Bryce Wiedenbeck, Residual Networks and Skip Connections (DL 15)

- Papers with Code

⠀

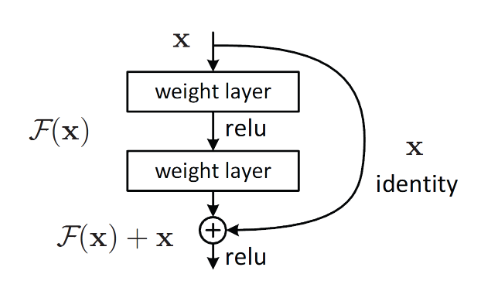

Definition: Residual Block

Sei

die durch ein neuronales Netzwerk im -ten Layer berechnete Funktion. Als residual Verbindung (auch Residual Layer oder Residual Block) bezeichnen wir

Die residual Verbindung ist also ein Zusatz zu der eigentlichen Layer-Funktion

, der nur darin besteht, den ursprünglichen Input zu dem Output der Layer-Funktion hinzuzuaddieren. Die Idee ist, dass die “Residualfunktion”

einfacher zu lernen ist als die Funktion .

Anmerkung

Konkatenation statt Addition?

Statt

hinzuzuaddieren, können wir uns auch dazu entscheiden, ihn bspw. an das Ergebnis von zu konkatenieren.

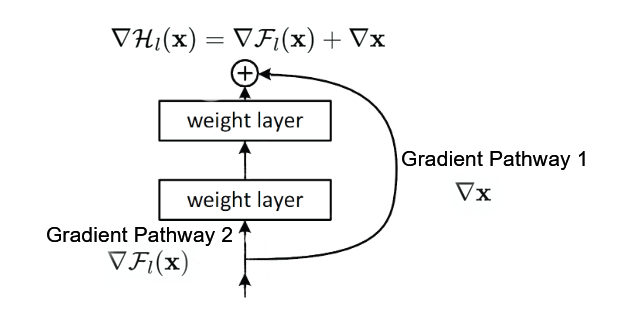

Verbindung zu dem Vanishing Gradient Problem

Gerade zu Beginn des Trainings, wenn die Gewichte noch nah an den Initialwerten liegt, sorgt die Addition von

dafür, dass Informationen über die Input Daten nicht vollständig (durch die Multiplikationen mit den ungelernten Gewichten) verloren gehen. Außerdem ist

Durch die Additivität kann der Gradient ebenfalls Layer überspringen. So gelangen Informationen aus den unteren Layern unverfälschter zu den oberen Layern.

Identitäts vs. Conv-Blöcke

Residual Blöcke kommen in zwei Geschmacksrichtungen als Identity Block und als Downsampling Block.

Während die Identity Blöcke tatsächlich nur eine Addition durchführen, werden für die Downsampling Blöcke

Convolutions mit einem Stride durchgeführt.