Typen:Konstrukte:Generalisierungen:Eigenschaften:Involvierte Definitionen:Veranstaltung: EMLReferenz: @thimm2024 (Abschnitt 5.3.1)

⠀

Definition: Rekurrenter Layer

Als Rekurrenten Layer bezeichnen wir einen Layer-Typen neuronaler Netzwerke, der zusätzlich zur Eingabe

einen internen hidden state hält. Sei

die aktuelle Eingabe.

Seider Hidden State des letzten Schrittes.

Seiendie Gewichtsmatrizen des Layers, seien die entsprechenden Bias-Terme und die entsprechenden Aktivierungsfunktionen. In jedem Schritt erhalten wir zwei Ergebnisse:

- der neue Hidden State:

- der Output:

Für eine Sequenz

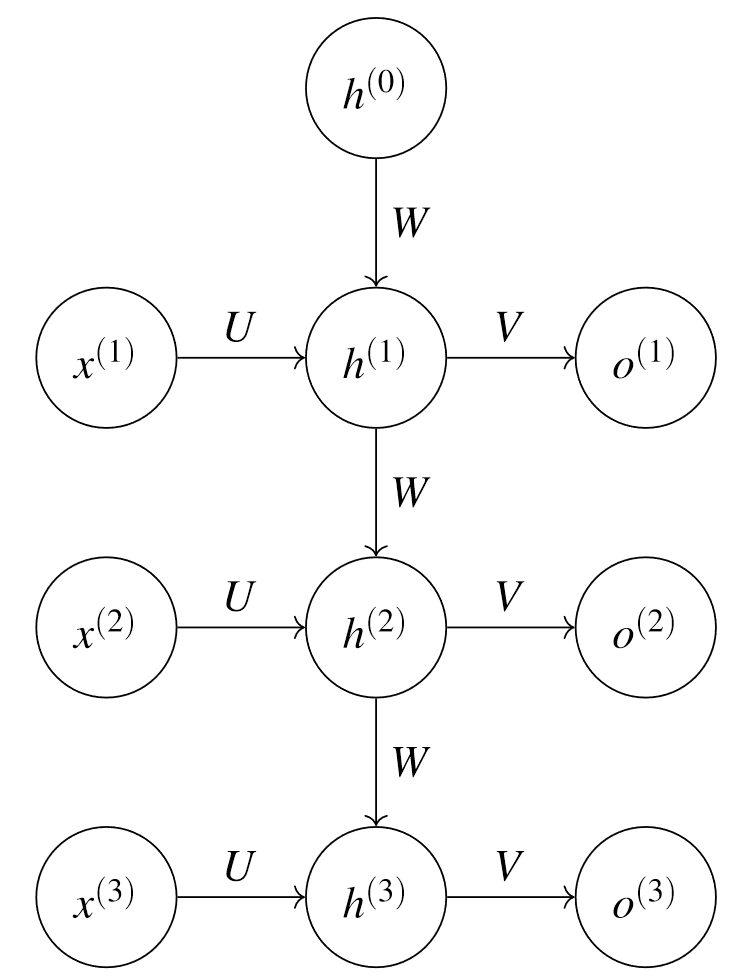

erhalten wir als Berechnungsgraphen:

Anmerkung

Elman Netzwerk

Die hier präsentierte Art eines RNNs orientiert sich an Jeffrey Elman’s Formulierung eines

Simple Recurrent Neural Networksvon 1990.

Wie wird

initialisiert? Für die Initialisierung des ersten Hidden States

gibt es drei häufige Ansätze:

- Null-Initialisierung, also

, - Random-Initialisierung, bspw. auf Basis einer Normalverteilung,

- Lernbar,

wird also anhand von Backpropagation trainiert.

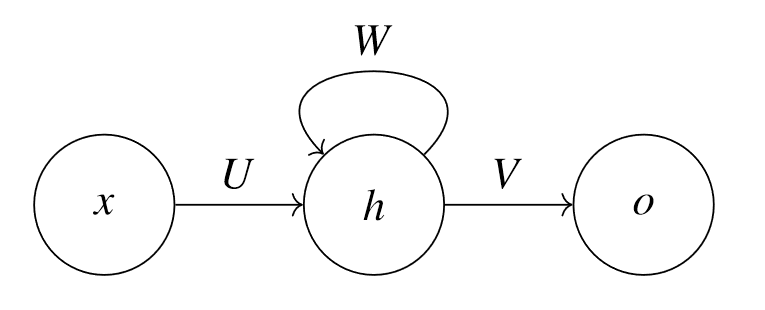

Kompakter Berechnungsgaph

Allgemein lässt sich der Berechnungsgraph eines rekurrenten Layers reduziert darstellen durch

Die Schleife steht für die Einbeziehung des Hidden States

im Schritt .

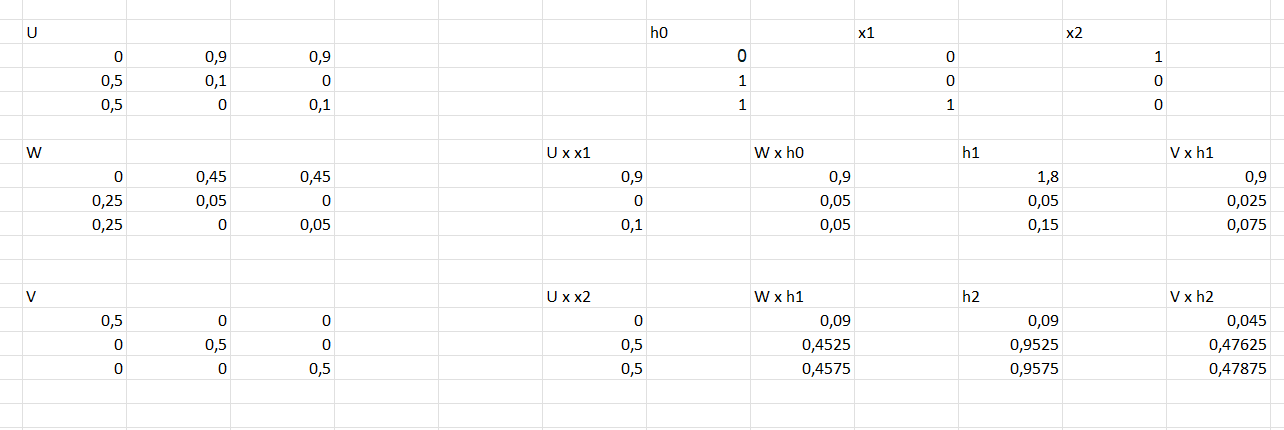

RNN in Excel?

In Excel können wir RNNs ziemlich einfach wie folgt berechnen nach dem Schema

=MMULT(<M>; <x>)berechnen: